GLM-5.1 : 754B paramètres — le modèle phare de Z.ai pour l'ingénierie agentique

- Bastien

- 08 Apr, 2026

De GLM-5 à GLM-5.1 : le saut agentique

Moins de deux semaines après la sortie de GLM-5, Z.ai (anciennement ZhipuAI) publie GLM-5.1 — un modèle Mixture of Experts de 754 milliards de paramètres qui ne se contente pas d’itérer sur son prédécesseur, mais redéfinit ce qu’un modèle open-weight peut accomplir sur des tâches agentiques de longue durée. Le sous-titre résume l’ambition : from Vibe Coding to Agentic Engineering.

Là où GLM-5 prouvait que l’architecture pouvait rivaliser sur les benchmarks, GLM-5.1 prouve qu’elle peut maintenir ses performances sur des centaines de tours de raisonnement et des milliers d’appels d’outils — le type de charge de travail qui fait échouer la plupart des modèles bien avant d’atteindre une solution.

Architecture : MoE avec attention dynamique éparse

GLM-5.1 utilise l’architecture GLM_MOE_DSA — Mixture of Experts avec Dynamic Sparse Attention. Le total de 754B paramètres est légèrement supérieur aux 744B de GLM-5, mais la vraie différence réside dans l’entraînement et le post-entraînement.

Le mécanisme d’attention dynamique éparse réduit le coût de calcul sur les longues séquences en ne portant attention qu’aux tokens les plus pertinents. Combiné au routage MoE, cela maintient un coût d’inférence par token gérable même lorsque la fenêtre de contexte dépasse 200K tokens.

Le modèle est distribué en BF16/FP32, avec des variantes quantifiées disponibles via llama.cpp, LM Studio, Jan et Ollama (9 formats de quantification).

Résultats sur les benchmarks

Ingénierie agentique et code

| Benchmark | GLM-5.1 | GLM-5 |

|---|---|---|

| SWE-Bench Pro | 58.4% | — |

| SWE-bench Verified | — | 77.8% |

| Terminal-Bench 2.0 | 63.5% | 56.2% |

| Terminal-Bench (Claude Code) | 69.0% | — |

| NL2Repo | 42.7% | — |

| Tool-Decathlon | 40.7% | — |

| τ³-Bench | 70.6% | — |

SWE-Bench Pro est une variante plus difficile de SWE-bench qui teste la résolution de problèmes multi-fichiers et multi-étapes. GLM-5.1 domine ce benchmark. Les scores Terminal-Bench progressent nettement, et le nouveau benchmark NL2Repo évalue la génération complète de dépôts à partir de spécifications en langage naturel.

Mathématiques et raisonnement

| Benchmark | GLM-5.1 | GLM-5 |

|---|---|---|

| AIME 2026 | 95.3% | 92.7% |

| HMMT Nov 2025 | 94.0% | 96.9% |

| GPQA-Diamond | 86.2% | 86.0% |

| IMOAnswerBench | 83.8% | — |

| HLE (avec outils) | 52.3% | 50.4% |

AIME et GPQA-Diamond progressent tous les deux. HMMT recule légèrement (94.0% contre 96.9%), ce qui suggère que le post-entraînement a été optimisé pour les tâches agentiques plutôt que pour les mathématiques de compétition pure.

Cybersécurité et navigation web

| Benchmark | GLM-5.1 | GLM-5 |

|---|---|---|

| CyberGym | 68.7% | 43.2% |

| BrowseComp | 68.0% | — |

Le bond de CyberGym de 43.2% à 68.7% est frappant — une amélioration de +25.5 points qui reflète une meilleure utilisation des outils et un raisonnement itératif plus efficace en environnement adversarial.

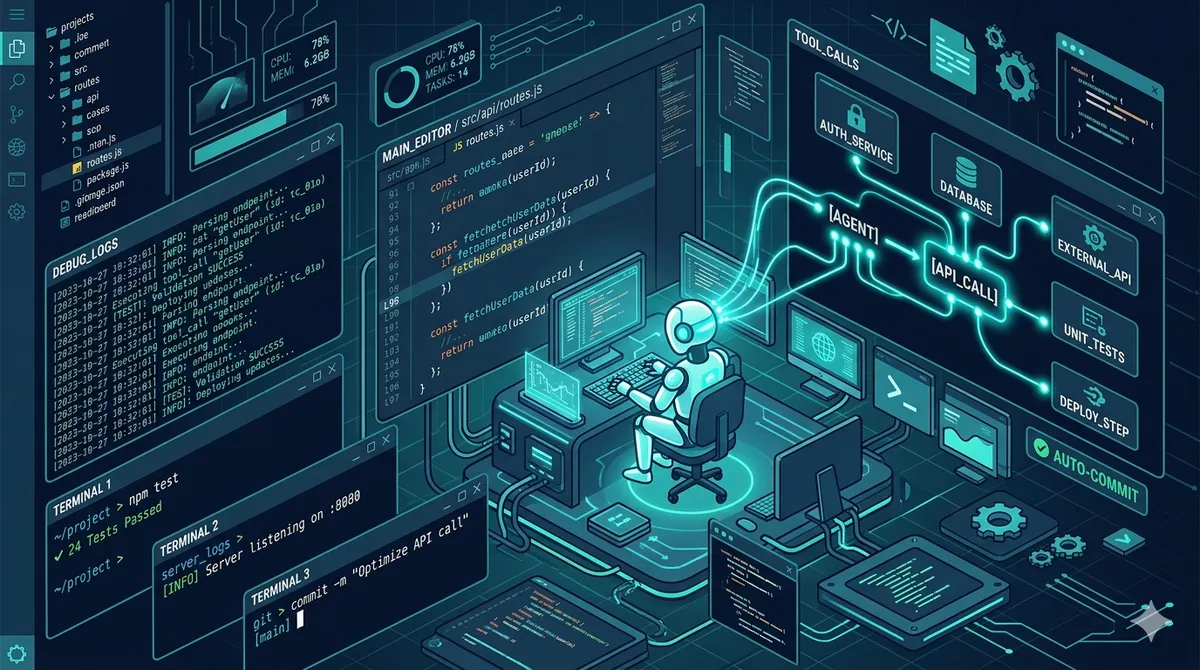

Ce qui le distingue : la persistance sur le long terme

La plupart des grands modèles plafonnent après quelques dizaines d’étapes de raisonnement. GLM-5.1 a été spécifiquement post-entraîné pour maintenir ses performances sur des sessions agentiques prolongées — des centaines de tours, des milliers d’appels d’outils et des révisions de stratégie répétées.

C’est le différenciateur clé. Sur des benchmarks comme Terminal-Bench et SWE-Bench Pro, le succès ne dépend pas de la justesse du premier essai, mais de la capacité à itérer : lancer des expériences, lire les messages d’erreur, réviser son approche et réessayer. GLM-5.1 fait cela sans perdre cohérence ni contexte.

Z.ai décrit cette évolution comme le passage du « vibe coding » (générer du code plausible en un coup) à l’« ingénierie agentique » (résoudre systématiquement des problèmes complexes par une interaction soutenue).

Déploiement

GLM-5.1 est pris en charge par plusieurs frameworks d’inférence :

- SGLang (v0.5.10+)

- vLLM (v0.19.0+)

- xLLM (v0.8.0+)

- Transformers (v0.5.3+)

- KTransformers (v0.5.3+)

Neuf variantes quantifiées sont disponibles pour le déploiement local via llama.cpp, LM Studio, Jan et Ollama.

Une API est accessible via la plateforme Z.ai, et une interface de chat arrive bientôt sur chat.z.ai.

Licence et accès

GLM-5.1 est publié sous licence MIT — l’une des licences les plus permissives de l’IA open-source. C’est une amélioration significative par rapport à GLM-5, dont la licence n’était pas clairement spécifiée. La MIT autorise l’utilisation commerciale, la modification et la redistribution avec des restrictions minimales.

Langues supportées : anglais et chinois.

Conclusion

GLM-5.1 n’est pas une mise à jour mineure. Le passage de la performance sur les benchmarks à la capacité agentique soutenue représente un véritable changement de philosophie architecturale et d’entraînement. Leader sur SWE-Bench Pro à 58.4%, un score CyberGym presque doublé, et une licence MIT font de ce modèle le plus solide des modèles open-weight pour les développeurs construisant des systèmes agentiques.

Pour les équipes qui évaluent des alternatives auto-hébergées aux API propriétaires pour les agents de code, l’automatisation en terminal ou la résolution de tâches complexes, GLM-5.1 vient de prendre la première place.

Modèle : zai-org/GLM-5.1 · Article : arxiv.org/abs/2602.15763

Tags :

- IA

- Z.ai

- LLM

- MoE

- Agentique

- Open Source

- Code