Qianfan-OCR : le modèle 4B de Baidu qui surpasse Gemini sur l'analyse de documents

- Bastien

- 30 Mar, 2026

Qu’est-ce que Qianfan-OCR ?

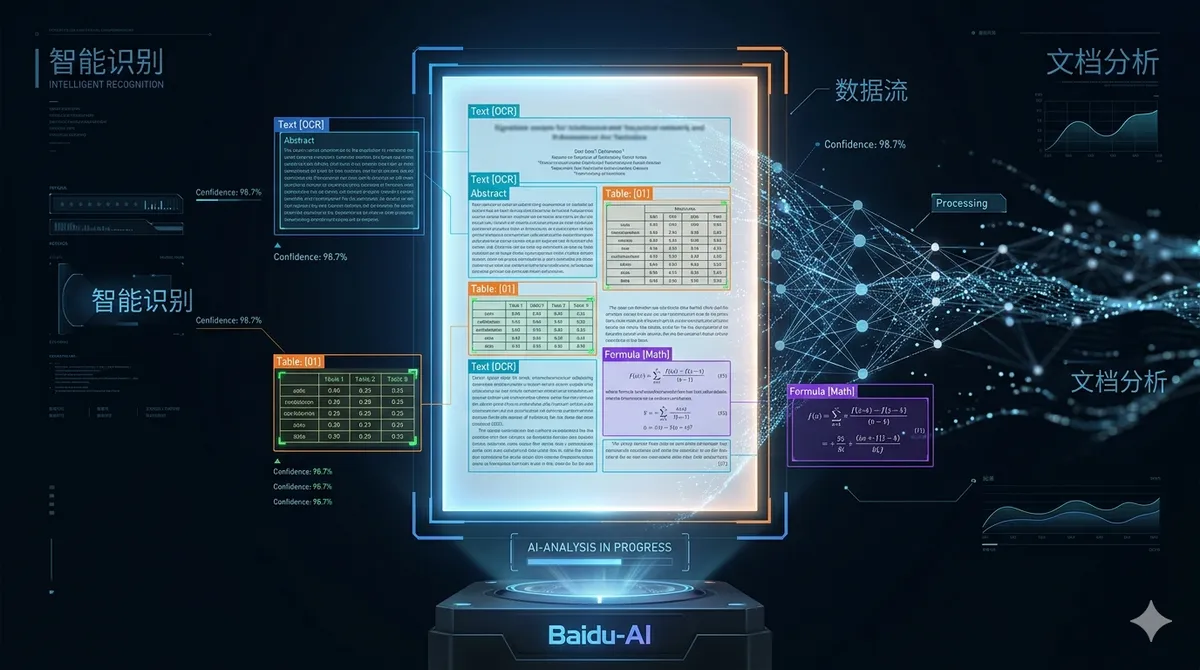

Qianfan-OCR est un modèle de compréhension de documents publié par Baidu. Il convertit des images de documents — PDFs, scans, photos, captures d’écran — directement en Markdown structuré, JSON ou HTML, en traitant tout : du texte simple aux tableaux complexes, formules mathématiques et graphiques.

Il se classe n°1 sur OmniDocBench v1.5, le benchmark principal pour l’analyse de documents bout-en-bout, avec un score global de 93,12 — devant DeepSeek-OCR-v2 (91,09) et Gemini 3 Pro (90,33).

La décision architecturale clé est de tout faire dans un seul modèle plutôt que d’enchaîner des modules OCR, mise en page et compréhension séparés. Cela évite la perte d’information entre les étapes du pipeline — ce qui compte surtout pour les documents complexes comme les graphiques, les sujets d’examen ou les mises en page multi-colonnes.

Architecture

Le modèle comprend trois composants :

- Qianfan-ViT — un encodeur visuel avec une conception AnyResolution. Il découpe l’image en tuiles de 448×448 et traite jusqu’à 4 096 tokens visuels, supportant les images jusqu’à 4K sans perdre de détails sur les documents denses.

- Qwen3-4B — le backbone linguistique de la série Qwen3 d’Alibaba, avec Grouped Query Attention (32 têtes query / 8 têtes KV) et une fenêtre de contexte de 32K extensible à 131K.

- Adaptateur cross-modal — un MLP 2 couches qui relie la sortie 1024-dim de l’encodeur visuel à l’entrée 2560-dim du modèle de langage.

Total : ~4B paramètres (5B avec les embeddings).

Layout-as-Thought

La fonctionnalité la plus originale de Qianfan-OCR est le Layout-as-Thought — un mode de réflexion qui récupère l’analyse structurelle au sein d’un modèle bout-en-bout.

Lorsqu’il est activé (en ajoutant <think> au prompt), le modèle génère d’abord une représentation structurée de la page — boîtes englobantes, types d’éléments sur 25 catégories, et ordre de lecture — avant de produire la sortie finale. C’est le type d’information que les pipelines multi-étapes classiques calculent séparément à chaque étape, mais ici cela se passe dans un seul passage.

Quand utiliser le mode thinking :

| Type de document | Recommandation |

|---|---|

| Sujets d’examen, rapports techniques, journaux | Activer (<think>) |

| Articles scientifiques avec équations et tableaux | Activer (<think>) |

| Texte mono-colonne, formulaires simples | Désactiver — meilleurs résultats sans |

| Reçus et factures | Désactiver |

Tâches prises en charge

25 types d’éléments sur 9 catégories de tâches :

| Catégorie | Détails |

|---|---|

| Analyse de documents | Image → Markdown, multi-pages, sortie JSON/HTML |

| Analyse de mise en page | Boîtes englobantes, 25 types d’éléments, ordre de lecture |

| Reconnaissance de tableaux | Cellules fusionnées, tableaux pivotés, sortie HTML |

| Reconnaissance de formules | Maths en ligne et en bloc, sortie LaTeX |

| Compréhension de graphiques | QA, analyse de tendances, extraction de données |

| Extraction d’informations clés | Factures, reçus, cartes d’identité, dossiers médicaux |

| Écriture manuscrite | Chinois et anglais |

| Texte en scène naturelle | Panneaux, étiquettes, images naturelles |

| OCR multilingue | 192 langues (latin, cyrillique, arabe, CJK, etc.) |

Résultats des benchmarks

OmniDocBench v1.5 — n°1 global

| Modèle | Global | Dist. édition texte | Formule | Table TEDs | Table TEDss | Ordre lecture |

|---|---|---|---|---|---|---|

| Qianfan-OCR | 93,12 | 0,041 | 92,43 | 91,02 | 93,85 | 0,049 |

| DeepSeek-OCR-v2 | 91,09 | 0,048 | 90,31 | 87,75 | 92,06 | 0,057 |

| Gemini 3 Pro | 90,33 | 0,065 | 89,18 | 88,28 | 90,29 | 0,071 |

Extraction d’informations clés — n°1 (moyenne sur 5 benchmarks)

| Modèle | Score moyen KIE |

|---|---|

| Qianfan-OCR | 87,9 |

| Gemini 3.1 Pro | inférieur |

| Qwen3-VL-235B-A22B | inférieur |

Compréhension de documents et graphiques

| Benchmark | Score |

|---|---|

| DocVQA | 92,8 |

| CharXiv DQ | 94,0 |

| CharXiv RQ | 85,2 |

| ChartQA | 88,1 |

| ChartQAPro | 42,9 |

| ChartBench | 85,9 |

OCR général

| Benchmark | Score |

|---|---|

| OCRBench | 880 |

| OCRBench v2 (EN) | 56,0 |

| OCRBench v2 (ZH) | 60,77 |

| CCOCR multilingue | 76,7 |

Performances à l’inférence

Mesurées sur un seul NVIDIA A100 :

| Précision | Débit |

|---|---|

| W16A16 (BF16 complet) | 0,503 pages/seconde |

| W8A8 (quantifié) | 1,024 pages/seconde |

La quantification W8A8 double environ le débit — utile pour les pipelines de production traitant de gros volumes de documents.

Déploiement avec vLLM pour un service haute performance :

vllm serve baidu/Qianfan-OCR --trust-remote-code

Ou via l’API Transformers en local :

import torch

from transformers import AutoModel, AutoTokenizer

model = AutoModel.from_pretrained(

"baidu/Qianfan-OCR",

torch_dtype=torch.bfloat16,

trust_remote_code=True,

device_map="auto"

).eval()

tokenizer = AutoTokenizer.from_pretrained("baidu/Qianfan-OCR", trust_remote_code=True)

# Analyser un document en Markdown

response = model.chat(tokenizer, pixel_values=pixel_values,

question="Parse this document to Markdown.",

generation_config={"max_new_tokens": 16384})

# Avec Layout-as-Thought pour les mises en page complexes

response = model.chat(tokenizer, pixel_values=pixel_values,

question="Parse this document to Markdown.<think>",

generation_config={"max_new_tokens": 16384})

# Extraction d'informations clés en JSON

response = model.chat(tokenizer, pixel_values=pixel_values,

question="Extraire nom, date et montant total en JSON.",

generation_config={"max_new_tokens": 16384})

Écosystème du modèle

Limites

- trust_remote_code requis —

trust_remote_code=Truenécessaire pour le modèle et le tokenizer ; auditer le code avant de déployer dans des environnements sensibles - Compréhension de graphiques complexes — le score ChartQAPro (42,9) indique que l’analyse de graphiques complexes a encore des marges de progression

- Pas de support PDF natif — il faut convertir les pages PDF en images au préalable

- Fenêtre de contexte — 32K par défaut, extensible à 131K ; les très longs documents nécessitent un découpage

- Licence — non précisée dans la fiche modèle ; vérifier le dépôt avant tout usage commercial

Conclusion

L’argument principal de Qianfan-OCR est sa position dans les benchmarks : il surpasse à la fois un modèle fermé frontier (Gemini 3 Pro) et la meilleure alternative open source (DeepSeek-OCR-v2) sur le principal benchmark d’analyse de documents, avec un seul modèle de 4B paramètres. Le mécanisme Layout-as-Thought est une solution pragmatique à la tension classique entre la simplicité bout-en-bout et l’analyse de mise en page structurée.

Pour les développeurs qui construisent des pipelines documentaires — traitement de factures, correction d’examens, extraction de rapports, ou RAG sur des documents scannés — c’est l’option open weights la plus solide disponible à cette taille.

Modèle : baidu/Qianfan-OCR

Tags :

- IA

- Baidu

- OCR

- Document AI

- Vision

- Open Source