Mistral Small 4 : Un Modèle d'IA Unifié qui Redéfinit l'Efficacité

- Bastien

- 18 Mar, 2026

Depuis quelques années, la course aux modèles de langage a souvent opposé deux extrêmes : les grands modèles puissants mais coûteux, et les petits modèles rapides mais limités. Mistral AI vient de briser cette dichotomie avec Mistral Small 4, un modèle qui revendique à la fois la légèreté, la polyvalence et la puissance de raisonnement. Voici une analyse approfondie de ce que cette sortie représente vraiment pour les développeurs, les entreprises et l’écosystème de l’IA open source.

Un modèle, trois missions

La proposition centrale de Mistral Small 4 est simple mais ambitieuse : réunir en un seul système trois capacités qui étaient jusqu’ici souvent dissociées.

Le raisonnement avancé d’abord. Depuis l’émergence des modèles dits “chain-of-thought”, la capacité à décomposer un problème complexe en étapes logiques est devenue un critère de référence. Mistral Small 4 intègre cette fonctionnalité nativement, avec la possibilité de moduler l’intensité du raisonnement selon les besoins.

La génération de code et les workflows agentiques ensuite. À mesure que les développeurs adoptent des pipelines d’IA pour automatiser des tâches — écriture de tests, revue de code, génération de documentation — la qualité et la concision du code produit deviennent cruciales. Mistral Small 4 a été optimisé pour produire un code plus court et plus lisible que ses concurrents, tout en maintenant un niveau de précision équivalent.

La compréhension multimodale enfin. Le modèle accepte nativement des entrées textuelles et des images, ouvrant la voie à des applications d’analyse documentaire, de traitement de factures, de compréhension de schémas techniques ou d’assistance visuelle.

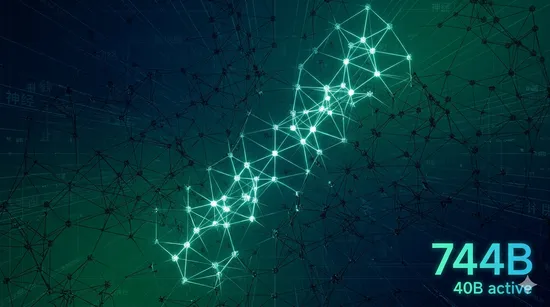

L’architecture Mixture of Experts : ce que les chiffres cachent

Sur le papier, 119 milliards de paramètres impressionnent. Mais ce chiffre brut ne raconte pas l’histoire complète. Mistral Small 4 repose sur une architecture Mixture of Experts (MoE), une approche où le modèle n’active qu’une fraction de ses capacités pour chaque token traité.

Concrètement : sur les 128 experts disponibles dans le réseau, seulement 4 sont activés par token. Cela se traduit par 6 milliards de paramètres actifs lors de l’inférence, malgré un poids total de 119 milliards. L’analogie est celle d’une bibliothèque immense où un bibliothécaire expert consulte uniquement les rayons pertinents pour répondre à votre question, plutôt que de parcourir l’intégralité des collections.

Cette architecture a des conséquences directes sur les performances :

- Réduction de la latence de 40 % par rapport aux configurations optimisées précédentes

- Multiplication par 3 du débit (throughput) comparé à Mistral Small 3

- Fenêtre de contexte de 256 000 tokens, suffisante pour traiter des documents entiers, des bases de code complètes ou des rapports techniques volumineux

Pour les équipes qui déploient des modèles en production, ces métriques ne sont pas anodines : elles se traduisent directement en coûts d’infrastructure réduits et en meilleures expériences utilisateur.

Le paramètre reasoning_effort : l’intelligence modulable

L’une des innovations les plus intéressantes de Mistral Small 4 est son paramètre reasoning_effort, qui permet d’ajuster dynamiquement la profondeur d’analyse du modèle selon le contexte.

En mode léger, le modèle se comporte comme Mistral Small 3.2 : réponses rapides, faible consommation de ressources, idéal pour les interactions conversationnelles simples ou les requêtes répétitives à faible complexité.

En mode intensif, le modèle adopte un raisonnement pas à pas, comparable aux capacités des anciens modèles Magistral. Il prend le temps de “réfléchir” avant de répondre, produisant des analyses plus structurées et moins sujettes aux erreurs sur des problèmes complexes.

Cette flexibilité est particulièrement précieuse pour les applications hybrides, où la majorité des requêtes sont simples mais où quelques cas complexes nécessitent une analyse approfondie. Plutôt que de maintenir deux modèles distincts, les développeurs peuvent orchestrer ce comportement avec un seul paramètre.

Les benchmarks : qualité et concision

Les résultats de benchmark présentés par Mistral AI méritent une lecture attentive, non pas pour les scores bruts, mais pour ce qu’ils révèlent sur la philosophie du modèle.

Raisonnement mathématique

Sur les tâches de raisonnement mathématique, Mistral Small 4 atteint un score de 0,72 avec des réponses de 1 600 caractères en moyenne. Ses concurrents directs obtiennent des scores comparables, mais en produisant des réponses 3,5 à 4 fois plus longues.

Ce ratio efficacité/longueur est rarement mis en avant dans les comparaisons de modèles, mais il est fondamental en production. Un modèle qui atteint la même précision avec quatre fois moins de tokens génère quatre fois moins de coûts d’inférence et répond quatre fois plus vite.

Génération de code

Sur les benchmarks de code, Mistral Small 4 produit des sorties 20 % plus courtes que les systèmes comparables, tout en maintenant un niveau de précision équivalent. Pour les développeurs qui utilisent ces modèles dans des pipelines d’automatisation, chaque token économisé représente un gain réel.

Il est important de noter que Mistral AI est transparent sur la méthodologie de ces benchmarks, une pratique qui reste malheureusement rare dans l’industrie et qui mérite d’être soulignée.

Infrastructure requise : ce qu’il faut prévoir

Déployer Mistral Small 4 en local n’est pas à la portée de tous. Compte tenu du poids total du modèle (119 milliards de paramètres en BF16 représentent environ 238 Go de mémoire GPU), les configurations minimales recommandées sont :

Configuration minimale :

- 4 GPU NVIDIA HGX H100

- 2 GPU NVIDIA HGX H200

- 1 système NVIDIA DGX B200

Configuration recommandée pour la production :

- 4× HGX H100, 4× HGX H200 ou 2× DGX B200

Ces prérequis placent clairement Mistral Small 4 dans la catégorie des modèles destinés aux équipes disposant d’une infrastructure GPU substantielle ou utilisant des APIs cloud. Pour les développeurs indépendants ou les petites équipes, l’accès via l’API Mistral ou les plateformes partenaires reste la voie la plus pragmatique.

Il convient de rappeler que malgré l’architecture MoE qui réduit les paramètres actifs à 6 milliards lors de l’inférence, l’intégralité du modèle doit résider en mémoire. L’analogie de la bibliothèque s’arrête là : le bibliothécaire n’utilise que quelques rayons, mais tous les livres doivent être physiquement présents.

Cas d’usage : qui bénéficie le plus de Mistral Small 4 ?

Les développeurs et équipes d’ingénierie

Les workflows agentiques sont probablement le cas d’usage le plus prometteur à court terme. Un agent IA capable de lire du code existant (grâce à la fenêtre de 256K tokens), de comprendre des schémas d’architecture (grâce au multimodal), de raisonner sur les bugs potentiels (grâce au reasoning_effort élevé) et de générer des correctifs concis (grâce à l’optimisation code) constitue un outil de productivité de premier ordre.

Les entreprises avec des besoins documentaires

L’analyse de longs documents juridiques, financiers ou techniques bénéficie directement de la fenêtre de contexte étendue. Contrairement aux approches RAG (Retrieval-Augmented Generation) qui découpent les documents en fragments, un modèle capable d’ingérer 256 000 tokens peut maintenir une compréhension globale du document et de ses interdépendances.

Les équipes de recherche

Les problèmes mathématiques complexes, la vérification formelle et l’exploration d’hypothèses scientifiques tirent parti du mode de raisonnement intensif. La capacité à produire des raisonnements structurés sans hallucinations excessives est un prérequis pour ces applications.

Les entreprises souhaitant garder le contrôle de leurs données

La licence Apache 2.0 et la disponibilité sur Hugging Face permettent un déploiement entièrement on-premise. Pour les secteurs soumis à des contraintes réglementaires strictes (santé, finance, défense), cette option est souvent non négociable.

L’écosystème de déploiement

Mistral Small 4 est disponible via plusieurs canaux :

API Mistral : accès immédiat sans infrastructure, facturation à l’usage, idéal pour prototyper et pour les applications avec des volumes variables.

AI Studio : environnement de test et d’évaluation.

Hugging Face : téléchargement des poids du modèle pour déploiement personnalisé, fine-tuning, ou intégration dans des pipelines ML existants.

NVIDIA Build : prototypage gratuit dans l’environnement cloud NVIDIA.

NVIDIA NIM : déploiement en production via des conteneurs d’inférence optimisés pour les GPU NVIDIA. Cette option est particulièrement pertinente pour les équipes déjà investies dans l’écosystème NVIDIA.

NVIDIA NeMo : framework de fine-tuning pour adapter le modèle à des domaines spécifiques — vocabulaire médical, jargon juridique, bases de code propriétaires, etc.

Licence Apache 2.0 : ce que cela change vraiment

La licence Apache 2.0 n’est pas qu’un détail technique. Elle signifie concrètement :

- Utilisation commerciale libre sans redevance à Mistral AI

- Modification du modèle autorisée, y compris pour créer des dérivés propriétaires

- Redistribution des poids originaux ou modifiés

- Fine-tuning pour des cas d’usage spécialisés sans restrictions contractuelles

Dans un marché où plusieurs acteurs maintiennent des licences restrictives ou des conditions d’utilisation opaques, cette ouverture constitue un avantage compétitif réel pour les entreprises qui souhaitent construire des produits durables sur des fondations stables.

Comparaison avec l’écosystème existant

Sans entrer dans des comparaisons directes de benchmarks — les conditions de test varient trop pour être équitables — quelques observations s’imposent.

Les modèles de taille comparable dans la catégorie “efficient reasoning” ont tendance à sacrifier soit la vitesse, soit la qualité de raisonnement. Mistral Small 4 tente de réconcilier ces deux dimensions via l’architecture MoE et le paramètre reasoning_effort.

Par rapport à Mistral Small 3, les gains de throughput (×3) et de latence (-40 %) sont substantiels. Pour une entreprise qui fait tourner des centaines de milliers de requêtes par jour, ces gains se traduisent directement en économies d’infrastructure.

Par rapport aux modèles de frontier (GPT-4o, Claude Opus, Gemini Ultra), Mistral Small 4 ne prétend pas égaler les performances sur les tâches les plus complexes. Son positionnement est différent : offrir 80 à 90 % des capacités à 20 à 30 % du coût, avec la flexibilité d’un déploiement on-premise.

Ce qu’on ne sait pas encore

Toute nouvelle sortie de modèle s’accompagne d’incertitudes que les benchmarks ne résolvent pas.

La robustesse en conditions réelles : les benchmarks académiques mesurent des capacités dans des conditions contrôlées. Les performances sur des tâches métier spécifiques, avec des données hétérogènes et des requêtes imparfaitement formulées, ne sont connues qu’après des semaines de déploiement.

Le comportement sur les langues minoritaires : bien que Mistral AI soit une entreprise française et que ses modèles soient généralement bons en français, les performances sur des langues moins représentées dans les données d’entraînement restent à évaluer.

La qualité du fine-tuning : la promesse du fine-tuning via NeMo est attrayante, mais la facilité avec laquelle un domaine spécifique peut être adapté sans dégradation des capacités générales (catastrophic forgetting) ne peut être évaluée qu’en pratique.

Conclusion : un signal fort pour l’IA open source efficiente

Mistral Small 4 représente une avancée significative dans ce que les chercheurs appellent l’efficience computationnelle : faire plus avec moins, sans compromis apparent sur la qualité.

L’architecture MoE n’est pas nouvelle, mais son implémentation à cette échelle, combinée à une fenêtre de contexte de 256 000 tokens, à une véritable multimodalité et à un mécanisme de raisonnement modulable, constitue une combinaison inédite dans cette catégorie de modèles.

Pour les équipes qui évaluent leurs options en matière d’IA en 2026, Mistral Small 4 mérite une place sérieuse dans le tableau de comparaison — non pas comme alternative aux modèles de frontier pour les tâches les plus exigeantes, mais comme premier choix pour la grande majorité des cas d’usage professionnels où coût, latence et contrôle des données sont des contraintes réelles.

L’IA open source, longtemps perçue comme systématiquement inférieure aux modèles propriétaires, continue de combler l’écart. Mistral Small 4 est un nouveau pas dans cette direction.

Source officielle : Mistral AI — Mistral Small 4

Tags :

- Mistral

- LLM

- IA

- Open source

- Mixture of Experts

- Raisonnement

- Code